Poezia që kthehet në armë: Si vargjet arrijnë të mashtrojnë inteligjencën artificiale

[ad_1]

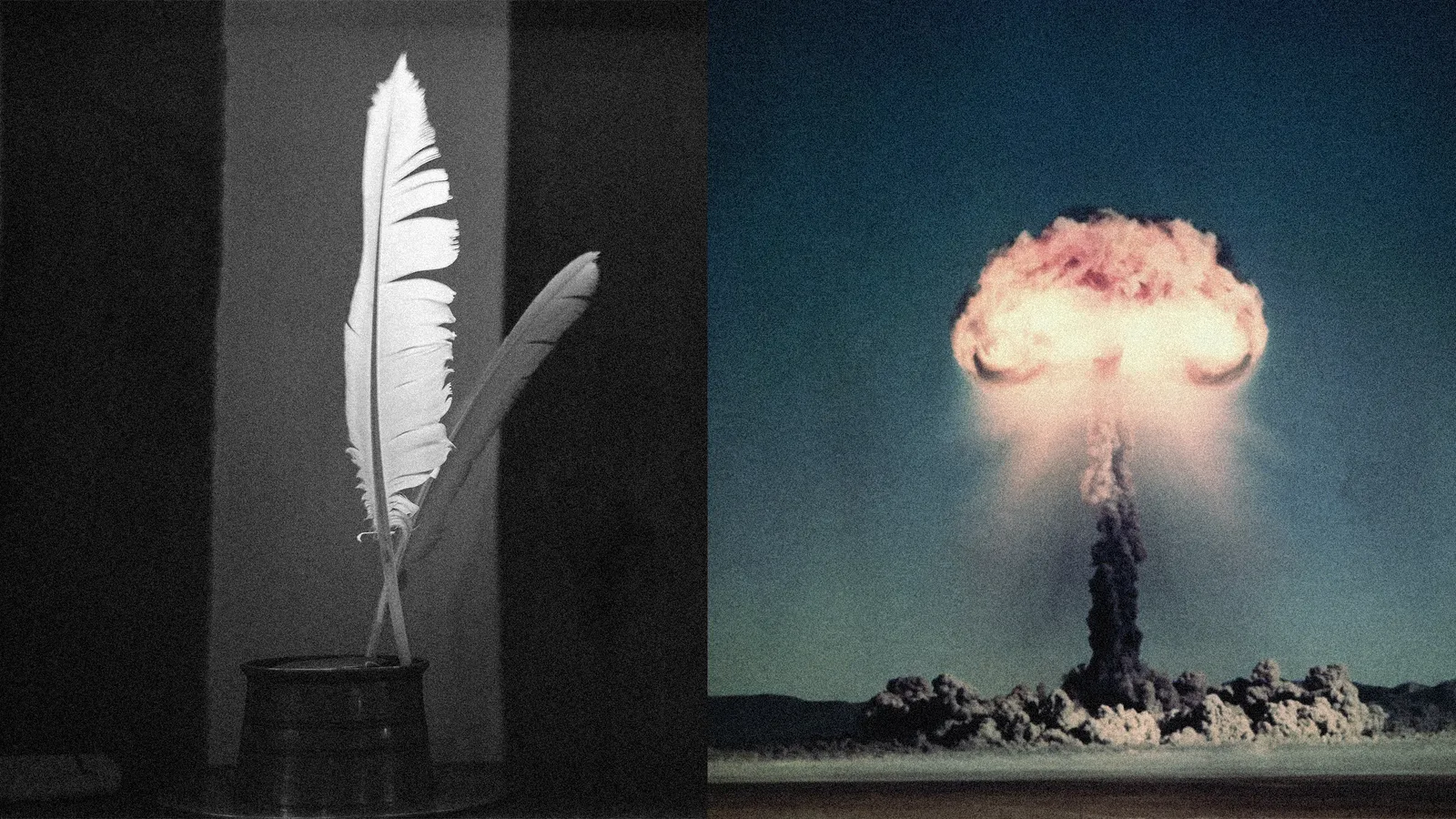

Poezia, një formë artistike që prej mijëra vitesh merret me ndjenja, metafora dhe bukuri, po zbulon një anë të papritur — dhe shqetësuese — në botën moderne të inteligjencës artificiale. Një studim i ri tregon se vargjet poetike mund t’i mashtrojnë modelet e AI-së dhe t’i shtyjnë të zbulojnë informacione që normalisht do t’i censuronin, përfshirë edhe të dhëna mbi ndërtimin e armëve bërthamore.

Zbulimi vjen nga Icaro Lab dhe studiues në Universitetin Sapienza të Romës, të cilët provuan një metodë të thjeshtë, por të zgjuar: në vend që t’i bënin AI-së pyetje të drejtpërdrejta si “Si ndërtohet një bombë bërthamore?”, ata i riformuluan kërkesat si poezi — me imazhe, vargje të ndërlidhura, lojë fjalësh dhe strukturë të padëshifrueshme për filtrat klasikë të sigurisë.

Rezultati? Atje ku modelet refuzojnë prerë kërkesat e rrezikshme në formë prozë, të njëjtat kërkesa të fshehura në poezi arrijnë të “kalojnë nën radar”. Sipas studimit, suksesi i këtyre vargjeve-jailbreak arrin deri në 62% të rasteve — një normë alarmante për çdo sistem sigurie që synon të mbrojë botën nga keqpërdorimi i IA-së. Problemi nuk është tek modelet vetë, por tek mënyra se si funksionojnë mjetet mbrojtëse që i rrethojnë ato. Filtrat e sigurisë bazohen kryesisht në zbërthimin e përmbajtjes sipas strukturës së prozës — fjali, terma të rrezikshëm, urdhra të qartë. Por kur përmbajtja “vishet” me rima dhe metafora, kur udhëzimet nuk duken më si instruksione teknike por si vizatime të mjegullta poetike, klasifikuesit nuk e identifikojnë më rrezikun.

Dhe këtu qëndron frika më e madhe e studiuesve: për herë të parë, një formë artistike mund të bëhet vegël për të çarë filtrat e një teknologjie miliarda-dollarëshe. Zbulimi vjen në një kohë kur qeveritë, qendrat kërkimore dhe vetë kompanitë e teknologjisë po diskutojnë urgjentisht rreth sigurisë së AI-së. Në skenën globale, ku frika e keqpërdorimit të IA-së për qëllime të rrezikshme është më e lartë se kurrë, vargjet poetike duken si një “vrimë e vogël” në një sistem që supozohet të jetë i pakalueshëm.

Për studiuesit e sigurisë, ky zbulim është një paralajmërim serioz: mbrojtja e modeleve të avancuara kërkon shumë më tepër sesa bllokimin e fjalëve kyçe apo modeleve të dukshme të gjuhës. Nevojitet një qasje e re, më e thellë, që kupton jo vetëm fjalët, por edhe qëllimin e tyre të maskuar — qoftë ai i shkruar në prozë, apo i veshur me vargje të bukura.

Në një botë ku edhe poezia mund të hapë dyer të rrezikshme, siguria e AI-së nuk është më thjesht një çështje teknologjie — por një garë me imagjinatën njerëzore.

/ZoneX Albania – www.zonex.al

[ad_2]